“Nên dùng CPU hay GPU để train AI?” — đây là câu hỏi xuất hiện hàng ngày trong mọi cộng đồng developer, data scientist và sinh viên AI tại Việt Nam. Câu trả lời không đơn giản là “GPU luôn tốt hơn”, bởi mỗi loại chip được thiết kế cho một nhóm tác vụ hoàn toàn khác nhau.

Bài viết này sẽ so sánh CPU và GPU toàn diện: từ kiến trúc, cách xử lý dữ liệu, đến bảng so sánh hiệu năng cụ thể cho từng tác vụ — giúp bạn biết chính xác khi nào cần CPU, khi nào cần GPU, và khi nào cần cả hai.

GPU vs CPU: CPU (Central Processing Unit) có ít lõi mạnh, tối ưu xử lý tuần tự và logic phức tạp. GPU (Graphics Processing Unit) có hàng nghìn lõi nhỏ, tối ưu xử lý song song khối lượng dữ liệu lớn. CPU giỏi “ra quyết định”, GPU giỏi “tính toán hàng loạt”. Chúng bổ sung cho nhau, không thay thế nhau.

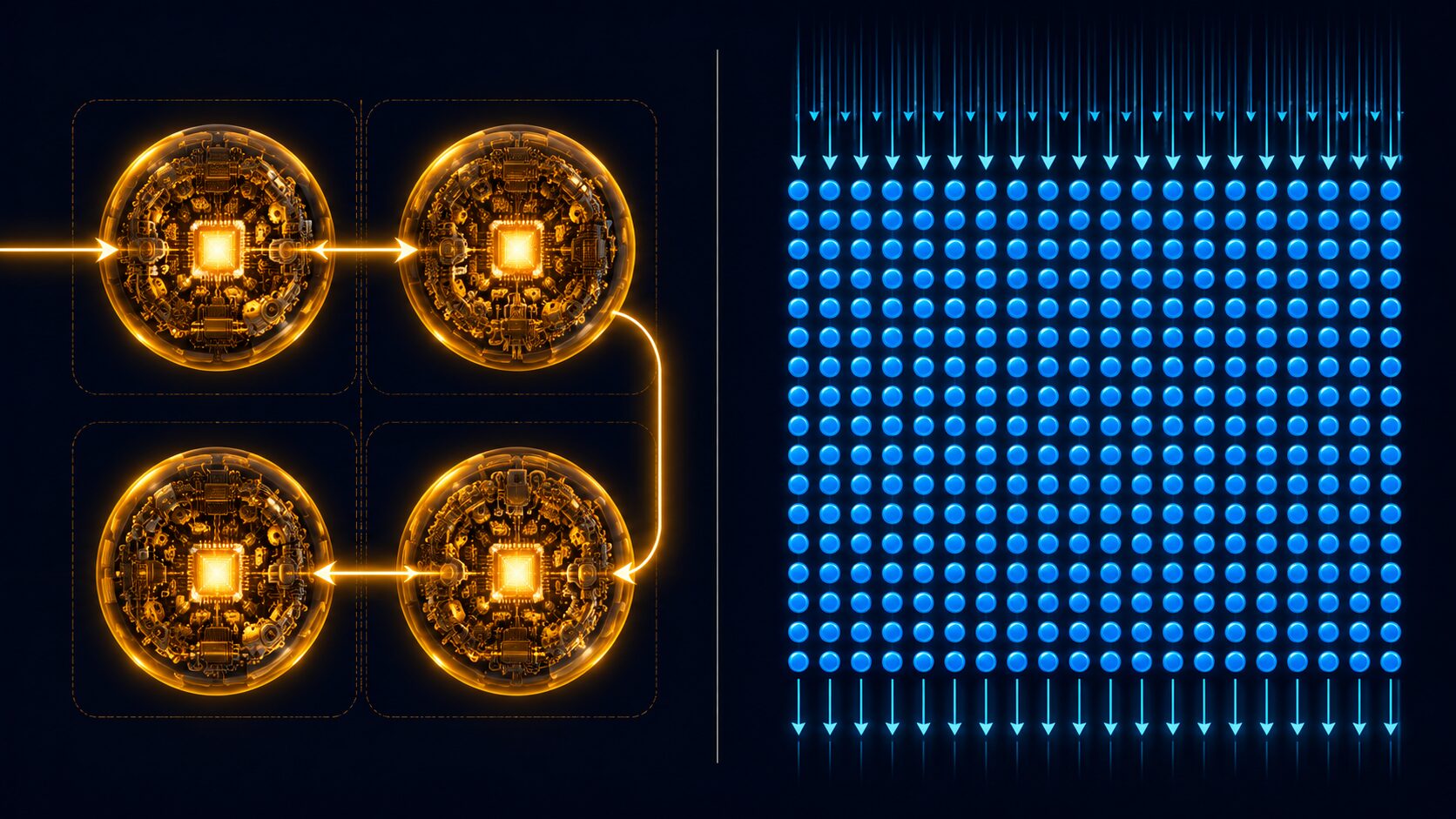

Kiến trúc CPU vs GPU — khác biệt cốt lõi

Sự khác biệt lớn nhất giữa CPU và GPU nằm ở triết lý thiết kế: CPU tập trung sức mạnh vào ít lõi, GPU phân tán sức mạnh ra hàng nghìn lõi.

CPU giống một giáo sư toán — giải được mọi loại bài toán, từ đơn giản đến cực khó, nhưng mỗi lúc chỉ giải được một bài. GPU giống 1.000 sinh viên toán — mỗi người chỉ giải được bài đơn giản, nhưng 1.000 người cùng giải cùng lúc thì xong 1.000 bài trong thời gian giáo sư mới xong 1 bài.

CPU — ít lõi mạnh, tuần tự

CPU hiện đại có 8–24 lõi (cores), mỗi lõi chạy ở xung nhịp rất cao (4–6 GHz) và có cache lớn. Kiến trúc này tối ưu cho xử lý tuần tự: đọc lệnh → tính toán → ra quyết định → rẽ nhánh. CPU giỏi ở những tác vụ cần logic phức tạp, xử lý điều kiện if/else liên tục, chạy hệ điều hành và quản lý đa nhiệm.

GPU — hàng nghìn lõi nhỏ, song song

GPU hiện đại chứa hàng nghìn đến hàng chục nghìn lõi xử lý (ví dụ RTX 5090: 21.760 CUDA cores). Mỗi lõi yếu hơn lõi CPU nhiều, nhưng tất cả chạy cùng lúc — thực hiện cùng một phép tính trên hàng nghìn phần dữ liệu khác nhau (kiến trúc SIMD — Single Instruction, Multiple Data). GPU vượt trội ở những tác vụ có thể chia nhỏ thành nhiều phần giống nhau: render pixel, nhân ma trận, xử lý ảnh.

Bảng so sánh CPU và GPU chi tiết

| Tiêu chí | CPU | GPU |

|---|---|---|

| Số lõi xử lý | 8–24 lõi (mạnh, đa dụng) | Hàng nghìn–chục nghìn lõi (nhỏ, chuyên biệt) |

| Xung nhịp | 4–6 GHz | 1,5–2,5 GHz |

| Kiểu xử lý | Tuần tự (MIMD) | Song song (SIMD) |

| Cache | Lớn (32–96 MB L3) | Nhỏ (chia cho nhiều lõi) |

| Bộ nhớ | RAM DDR4/DDR5 (tới 128 GB+) | VRAM GDDR6/7 hoặc HBM (8–80 GB) |

| Băng thông bộ nhớ | 50–100 GB/s | 500–3.000 GB/s (HBM3) |

| Giỏi ở đâu | Logic, rẽ nhánh, đa nhiệm, OS | Tính toán hàng loạt, render, AI, mô phỏng |

| Tiêu thụ điện | 65–250W (chip) | 75–450W (card) |

| Giá tham khảo | 3–25 triệu VNĐ | 3–80+ triệu VNĐ (card rời) |

| Framework AI | scikit-learn, pandas, numpy | PyTorch (CUDA), TensorFlow (CUDA) |

| Ví dụ chip 2026 | Intel Core i9-14900K, AMD Ryzen 9 7950X | NVIDIA RTX 5090, A100, H100 |

Khi nào chỉ cần CPU?

Không phải mọi tác vụ đều cần GPU. CPU là đủ (và thường hiệu quả hơn) cho những trường hợp sau:

- Lập trình và biên dịch code: Trình biên dịch (GCC, Clang) chạy tuần tự, tận dụng xung nhịp cao và cache lớn của CPU.

- Quản trị server, database: PostgreSQL, MySQL, Redis đều chạy chủ yếu trên CPU. Query SQL là tác vụ logic rẽ nhánh phức tạp — thế mạnh của CPU.

- Machine learning truyền thống: Nếu bạn dùng scikit-learn, XGBoost, Random Forest với dataset dưới vài triệu dòng, CPU xử lý tốt. Các thuật toán này không có tính song song mạnh như deep learning.

- Văn phòng, web, xem phim: Chrome, Word, Excel, video streaming — tất cả chạy mượt trên CPU + GPU tích hợp.

- Inference model nhẹ đã train sẵn: Chạy inference BERT, ViT nhỏ trên CPU hoàn toàn khả thi, đặc biệt khi đã quantize model xuống INT8.

Khi nào bắt buộc cần GPU?

GPU trở nên không thể thay thế khi tác vụ có tính song song cao — tức là cùng một phép tính được lặp lại trên hàng triệu điểm dữ liệu:

- Training deep learning: Neural network = hàng triệu phép nhân ma trận. GPU (đặc biệt Tensor cores) xử lý nhanh hơn CPU 10–100 lần cho tác vụ này.

- Gaming 3D: Render mỗi frame cần tính toán ánh sáng, bóng đổ, texture cho hàng triệu pixel — hoàn toàn song song, GPU sinh ra để làm việc này.

- Render video/3D: Blender, After Effects, DaVinci Resolve dùng GPU render nhanh gấp 5–20 lần CPU.

- GenAI (Stable Diffusion, LLM): Tạo ảnh AI, chạy LLM local — GPU là bắt buộc, cần tối thiểu 8 GB VRAM.

- Phân tích dữ liệu lớn (RAPIDS): NVIDIA RAPIDS tăng tốc cuDF, cuML trên GPU, xử lý dataset hàng chục triệu dòng nhanh hơn pandas 10–20 lần.

- HPC và mô phỏng khoa học: Mô phỏng động lực học phân tử, khí hậu, vật lý hạt — tất cả cần tính toán song song quy mô lớn.

CPU hay GPU cho AI và Deep Learning?

Đây là câu hỏi phổ biến nhất. Câu trả lời phụ thuộc vào loại AI bạn làm:

| Tác vụ AI | Nên dùng | Lý do |

|---|---|---|

| ML truyền thống (sklearn, XGBoost) | CPU | Thuật toán ít song song, dataset nhỏ–vừa |

| Training CNN (ResNet, YOLO) | GPU | Convolution = phép tính song song, GPU nhanh hơn 20–50x |

| Training Transformer / LLM | GPU (A100/H100) | Ma trận cực lớn, cần Tensor cores + VRAM 40–80 GB |

| Fine-tune LoRA model 7B | GPU | Cần tối thiểu 16 GB VRAM |

| Inference BERT/ViT nhỏ | CPU (hoặc GPU nhỏ) | Model nhỏ, có thể quantize INT8 chạy CPU |

| Inference LLM 7B+ (vLLM) | GPU | Cần VRAM lớn để load model, throughput cao |

| Stable Diffusion (tạo ảnh) | GPU (8+ GB VRAM) | Denoising U-Net = tính toán song song nặng |

| Xử lý dữ liệu (pandas, ETL) | CPU | Logic rẽ nhánh, I/O bound nhiều hơn compute |

| Xử lý dữ liệu lớn (RAPIDS) | GPU | cuDF/cuML tận dụng GPU song song, nhanh hơn 10–20x |

Nếu bạn train bất kỳ model deep learning nào (CNN, Transformer, GAN, Diffusion) — GPU là bắt buộc. Nếu bạn chỉ dùng scikit-learn, xử lý dữ liệu nhỏ hoặc chạy inference model nhẹ — CPU là đủ. Khi cần GPU nhưng không muốn mua phần cứng, hãy thuê GPU Cloud.

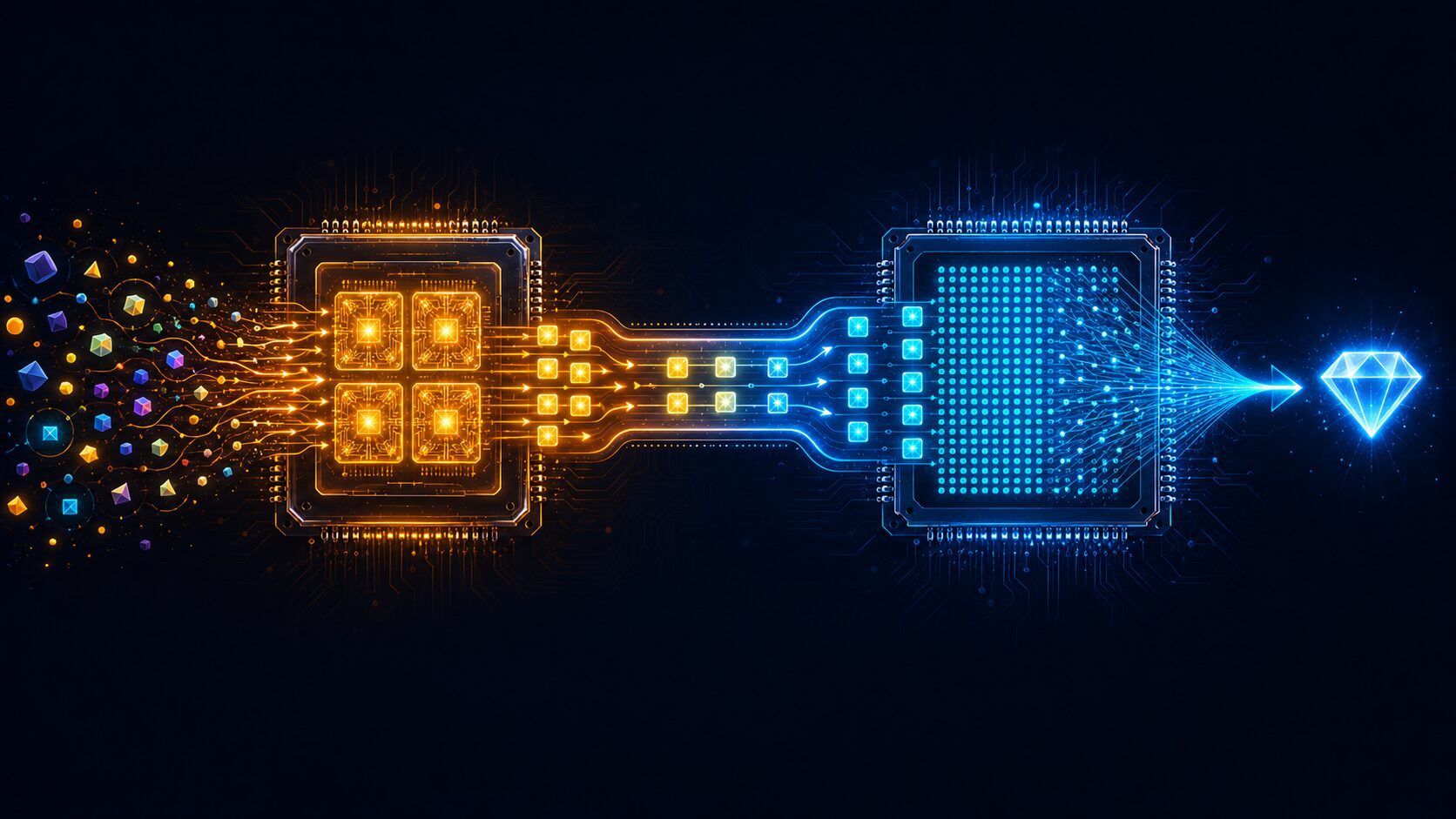

CPU + GPU phối hợp như thế nào?

Trong thực tế, CPU và GPU không bao giờ hoạt động riêng rẽ — chúng phối hợp trong một pipeline:

- CPU chuẩn bị dữ liệu: Đọc file, tiền xử lý (resize ảnh, tokenize text, normalize), tải dữ liệu vào RAM.

- CPU gửi dữ liệu cho GPU: Qua bus PCI Express, dữ liệu từ RAM hệ thống được copy sang VRAM của GPU.

- GPU tính toán nặng: Forward pass, backward pass, nhân ma trận — tất cả chạy song song trên hàng nghìn CUDA/Tensor cores.

- GPU trả kết quả về CPU: Loss, gradient, predictions được gửi lại.

- CPU điều phối tiếp: Cập nhật optimizer, log metrics, lưu checkpoint, quyết định epoch tiếp theo.

Nếu CPU quá yếu so với GPU (bottleneck), GPU sẽ phải “chờ” CPU chuẩn bị dữ liệu — lãng phí sức mạnh GPU. Nguyên tắc: RAM hệ thống nên gấp đôi tổng VRAM GPU. Ví dụ: 2 × RTX 3090 (48 GB VRAM) → cần tối thiểu 96 GB RAM.

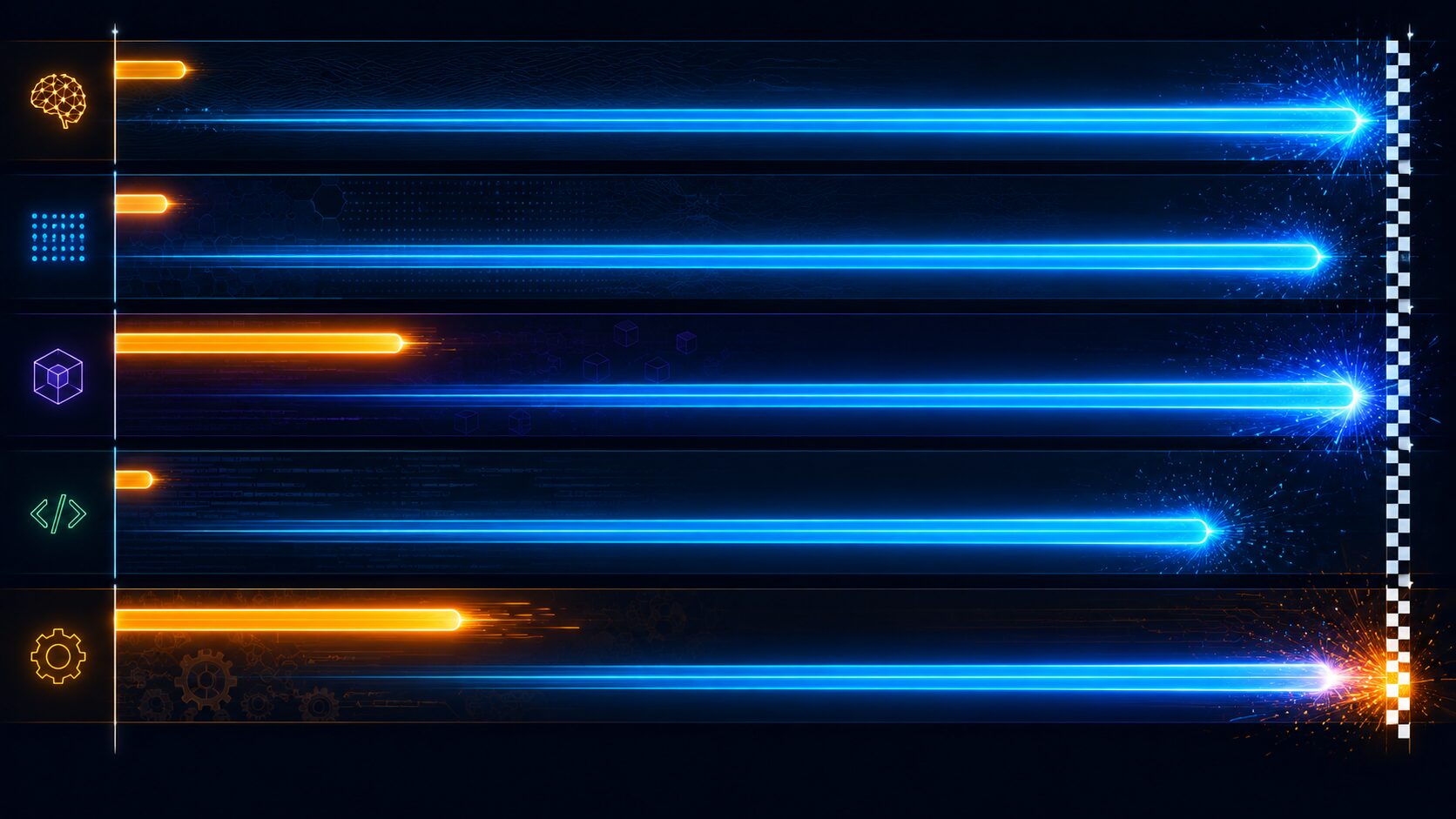

Benchmark thực tế: GPU nhanh hơn CPU bao nhiêu?

Dưới đây là benchmark tham khảo cho thấy sự khác biệt hiệu năng giữa CPU và GPU trong các tác vụ phổ biến:

| Tác vụ | CPU (Ryzen 9 7950X) | GPU (RTX 4090) | GPU nhanh hơn |

|---|---|---|---|

| Training ResNet-50 (1 epoch, ImageNet) | ~8 giờ | ~25 phút | ~19x |

| Fine-tune BERT-base (GLUE) | ~3 giờ | ~12 phút | ~15x |

| Stable Diffusion (1 ảnh 512×512) | ~10 phút | ~5 giây | ~120x |

| Render Blender (BMW scene) | ~6 phút | ~22 giây | ~16x |

| pandas groupby 10M rows | ~2 giây | ~0.15s (cuDF) | ~13x |

| Biên dịch Linux kernel | ~8 phút | N/A (CPU only) | — |

| PostgreSQL query phức tạp | ~0.5 giây | N/A (CPU only) | — |

Lưu ý: Benchmark trên là giá trị tham khảo tổng hợp từ nhiều nguồn. Kết quả thực tế phụ thuộc vào cấu hình cụ thể, dataset và cài đặt phần mềm.

Tham khảo thêm: Thuê GPU train AI: Nên chọn T4, A100 hay H100?

Câu hỏi thường gặp về GPU vs CPU

GPU và CPU khác nhau như thế nào?

CPU có ít lõi mạnh (8–24 cores), tối ưu xử lý tuần tự, logic phức tạp và đa nhiệm. GPU có hàng nghìn lõi nhỏ (CUDA cores), tối ưu xử lý song song khối lượng dữ liệu lớn. CPU giống một giáo sư giỏi giải bài toán phức tạp, GPU giống 1.000 sinh viên cùng giải 1.000 bài toán đơn giản cùng lúc. Chúng bổ sung nhau, không thay thế nhau.

Nên dùng CPU hay GPU cho AI và deep learning?

GPU vượt trội cho training deep learning vì neural network là hàng triệu phép nhân ma trận — tác vụ GPU xử lý song song nhanh hơn CPU 10–100 lần. CPU phù hợp cho machine learning truyền thống (scikit-learn, XGBoost), xử lý dữ liệu nhỏ, inference model nhẹ và NLP đơn giản. Nếu bạn train model deep learning, GPU là bắt buộc.

CPU có thể thay thế GPU cho gaming không?

Không. GPU tích hợp trong CPU chỉ chạy được game nhẹ (eSports, 2D). Game 3D hiện đại yêu cầu GPU rời để render hàng triệu polygon, tính ray tracing và chạy DLSS/FSR. Không có GPU rời, bạn không thể chơi game AAA ở cài đặt trung bình trở lên.

Khi nào chỉ cần CPU mà không cần GPU?

Chỉ cần CPU cho: lập trình, biên dịch, soạn văn bản, duyệt web, xem phim, quản trị server/database, machine learning truyền thống với dataset nhỏ, inference model nhẹ đã train sẵn (đặc biệt khi đã quantize). Nếu tác vụ không yêu cầu tính toán song song lớn, CPU là đủ.

Không có GPU mạnh thì train AI bằng cách nào?

Bạn có thể thuê GPU Cloud — dịch vụ cho thuê GPU qua Internet, trả tiền theo giờ sử dụng. Thay vì mua card đồ hoạ hàng chục triệu đồng, bạn truy cập GPU mạnh như A100, H100 từ xa. Sunteco Cloud cung cấp GPU Cloud tại Việt Nam với giá VNĐ, hỗ trợ tiếng Việt 24/7.

Cần GPU cho AI nhưng không muốn mua phần cứng?

Thuê GPU Cloud tại Sunteco — trả theo giờ, hạ tầng Việt Nam, hỗ trợ 24/7 tiếng Việt.

- ✅ GPU từ RTX 4060 đến H100 80GB

- ✅ Thanh toán VNĐ, không cần thẻ quốc tế

- ✅ Setup trong 5 phút, pre-installed CUDA + PyTorch

- ✅ Dùng thử miễn phí

Kết luận

CPU và GPU không phải đối thủ — chúng là đồng đội. CPU xử lý logic, điều phối hệ thống, chuẩn bị dữ liệu. GPU đảm nhận tính toán song song nặng: training AI, render đồ hoạ, mô phỏng khoa học. Hiểu đúng thế mạnh của từng loại giúp bạn chọn phần cứng (hoặc thuê GPU Cloud) phù hợp, tiết kiệm chi phí và tối ưu hiệu năng.

Nếu bạn cần GPU để train AI nhưng chưa sẵn sàng đầu tư phần cứng, hãy đăng ký dùng thử Sunteco GPU Cloud miễn phí ngay hôm nay.